Für welche Probleme sind Quantencomputer geeignet?

Schau dir das Video zu Anwendungen des Quantencomputings von Olivia Lanes an, oder öffne es in einem separaten Fenster auf YouTube.

Einleitung

In der vorherigen Lektion haben wir uns eingehend mit einem einzigen Problem befasst – dem Lösen des max-cut-Optimierungsproblems mithilfe der QUBO-Formulierung. Heute gehen wir einen anderen Weg und diskutieren Nahzeit-Anwendungen in einem breiteren Rahmen. Wir beginnen damit, dir ein Gefühl dafür zu geben, wie wir entscheiden, welche Arten von Problemen von einer Quantenlösung profitieren könnten. Anschließend schauen wir uns einige aktuelle Arbeiten aus unserer Community an. Das soll dir helfen, ein Gespür für die verschiedenen Arten von Quantencomputing-Problemen zu entwickeln und zu verstehen, wie wir sie angehen.

Klassische vs. quantenmechanische Schwierigkeit

Bevor wir in die Beispiele einsteigen, lass uns zunächst darüber sprechen, wie wir die Schwierigkeit verschiedener Probleme untersuchen und einordnen. Einige Probleme lassen sich leicht auf einem klassischen Computer lösen, und wir brauchen dafür keinen Quantencomputer. Auf der anderen Seite gibt es sehr schwere Probleme, für die Quantencomputer notwendig sind. Ein bekanntes Beispiel ist die Primfaktorzerlegung riesiger ganzer Zahlen. Die RSA-Verschlüsselung beruht auf der Schwierigkeit dieses Problems, und Shor's Algorithmus wurde entwickelt, um es auf einem Quantencomputer zu lösen. Ein weiteres Beispiel ist die Suche nach einer Lösung in einem unsortierten Datensatz – das kann theoretisch durch den als Grover-Algorithmus bekannten Quantenalgorithmus gelöst werden. Die meisten Experten sind sich jedoch einig, dass diese Arten von Algorithmen die Implementierung von Fehlerkorrektur erfordern und die Technologie dafür noch nicht bereit ist.

Wir suchen also nach Problemen, die wir irgendwo in einer Mitte zwischen sehr einfach und sehr schwer angehen können – solche, die die Quantencomputer von heute bewältigen können, die aber klassischen Computern Schwierigkeiten bereiten.

Komplexitätsklassen

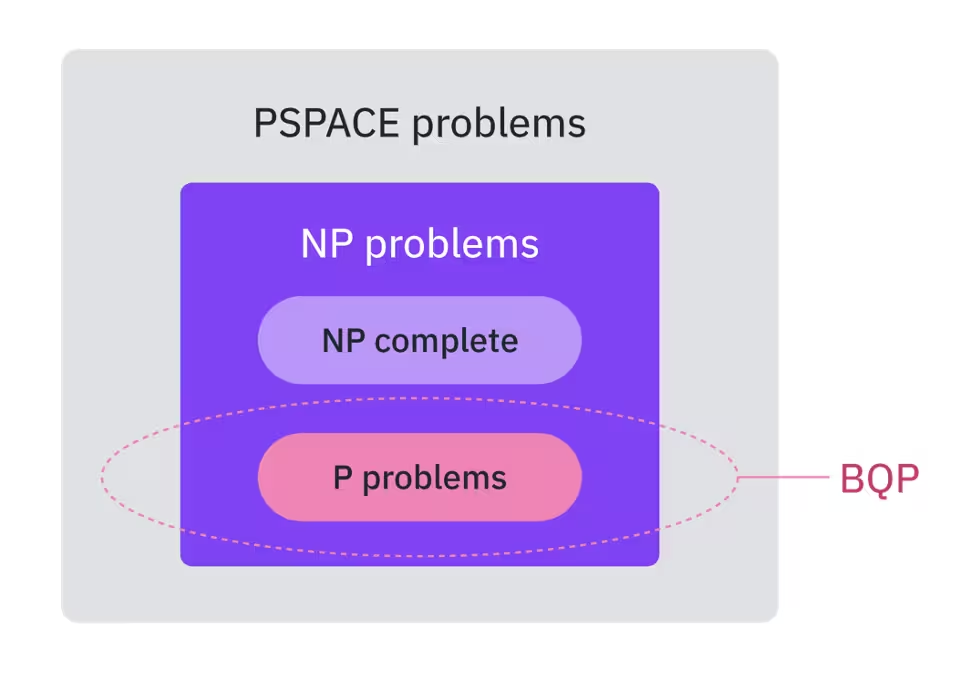

Die Schwierigkeit dieser Probleme wird in einem Teilgebiet der Informatik namens Berechnungskomplexitätstheorie kategorisiert und analysiert. Es gibt eine Vielzahl verschiedener Komplexitätsklassen im klassischen Computing, aber einige der grundlegendsten sind:

- P: Probleme, die in polynomieller Zeit lösbar sind, wenn die Problemgröße zunimmt. Sie sind einfach zu lösen.

- NP: Das steht für nichtdeterministisch polynomial. Diese Probleme können nicht notwendigerweise in polynomieller Zeit gelöst werden, aber ihre Antworten lassen sich in polynomieller Zeit verifizieren.

- NP-vollständig sind die schwierigsten Probleme in NP und haben keine bekannte polynomielle Lösung. Hier leben berühmte Probleme wie das Travelling-Salesman-Problem und das Spiel Sudoku.

- BPP, oder Bounded-Error Polynomial Problems, die von einem probabilistischen klassischen Computer in polynomieller Zeit innerhalb einer gewissen Fehlergrenze gelöst werden können.

Als das Konzept des Quantencomputings erfunden wurde, haben viele Forscher erhebliche Anstrengungen unternommen, um herauszufinden, welche Klasse von Problemen diese neuen Computertypen effizient lösen könnten. Eine neue Klasse von Problemen wurde eingeführt:

- BQP, oder Bounded-Error Quantum Polynomial Problems. Dies ist das quantenmechanische Äquivalent von BPP: Es ist die Klasse von Entscheidungsproblemen, die von einem Quantencomputer in polynomieller Zeit mit einer kleinen Fehlerwahrscheinlichkeit lösbar sind.

Alle diese Klassen leben in einer größeren Klasse, die wir PSPACE nennen. Oben ist ein Diagramm der vermuteten Beziehungen zwischen einigen Komplexitätsklassen, aber dies ist mathematisch sehr schwer definitiv zu beweisen. Du wirst feststellen, dass BQP sich nicht unbedingt mit NP-vollständig überschneidet. Dennoch gibt es Quantencomputing-Ansätze, die versuchen, Probleme in NP-vollständig zu lösen.

Ein häufiges Missverständnis ist, dass es keinen Sinn ergibt, Quantenlösungen für Probleme zu erforschen, für die kein mathematischer Beweis für eine Quantenbeschleunigung gefunden wurde. Aber einen mathematischen Beweis dafür zu finden, dass ein Quantenalgorithmus schneller als sein klassisches Gegenstück ist, ist schwierig. Shor's und Grover's sind zwei der bisher wenigen Beispiele, bei denen dies gelungen ist. Tatsächlich ist der rigorose Beweis, dass P und NP verschieden sind, eine der bekanntesten offenen Fragen in der gesamten Mathematik, obwohl alle Intuitionen darauf hindeuten, dass dies der Fall sein muss.

Die Art und Weise, wie ein Algorithmus mit wachsender Problemgröße skaliert – was in der Komplexitätsklasse widergespiegelt wird – ist jedoch nicht immer das relevanteste Merkmal eines Algorithmus. Diese Skalierung ist oft das Worst-Case-Szenario. Es ist durchaus möglich, dass wir in der Praxis nicht am häufigsten auf das Worst-Case-Szenario stoßen.

Nur weil Schwierigkeitsbeweise knifflig sind, bedeutet das nicht, dass wir keinen Fortschritt machen können. Wir führen die Idee heuristischer Lösungen ein. Wenn du Experimentalist bist, kennst und liebst du wahrscheinlich diese Art von Lösungen. Eine Heuristik ist jeder Ansatz zur Lösung eines Problems, der pragmatisch, aber nicht notwendigerweise optimal ist, da Lösungen nicht optimal sein müssen, um nützlich zu sein. Denk zum Beispiel an finanzielle Anwendungen. Wir haben noch keine exponentielle Beschleunigung für die meisten Finanzalgorithmen gefunden, bei denen Quanten eingesetzt werden könnten, aber wir brauchen keine optimale Lösung. Im Finanzwesen könnte selbst eine Lösung, die nur 0,1% effizienter ist, Milliarden von Dollar Gewinn bedeuten.

Die heutigen Quantencomputer und ihre Grenzen

Wie wissen wir also, welche Anwendungsfälle und Probleme derzeit für das Quantencomputing geeignet sein könnten? Gibt es gute Gründe zu glauben, dass Quantum Utility oder sogar Quantum Advantage jetzt oder in naher Zukunft gefunden werden kann?

Vielleicht ist es einfacher, zunächst die Dinge zu benennen, die das Problem sicher nicht haben sollte. Es kann keine riesige Anzahl von Qubits erfordern. Wir haben noch keine Prozessoren mit Tausenden bis Millionen von Qubits verfügbar. Das ist einer der Hauptgründe, warum Shor's Algorithmus und ähnliche noch so weit von der Realisierung entfernt sind. Die Circuits können auch nicht zu tief sein. Die Grenze der Circuit-Tiefe hängt von vielen Faktoren ab, aber im Allgemeinen gilt: Wenn dein Experiment eine Tiefe erfordert, die du noch nicht in der Literatur gesehen hast, wird es wahrscheinlich nicht funktionieren. Und schließlich können noch keine Algorithmen, von denen wir wissen, dass sie Fehlerkorrektur erfordern, umgesetzt werden.

All diese Einschränkungen werden in der IBM Quantum® Roadmap adressiert, und wir erwarten, Fehlerkorrektur in den frühen 2030er Jahren zu erreichen. Für jetzt aber müssen wir nach Experimenten suchen, die die meisten der derzeit auf einem QPU verfügbaren Qubits nutzen. Wir betonen auch die Bedeutung von Error Mitigation und Error Suppression. Und schließlich sollte es eine offensichtliche Erweiterung auf zukünftige Anwendungen geben, die für die Gesellschaft wichtig wären und die uns letztendlich zu einem Quantum Advantage führen könnten.

Anwendungsbereiche und Anwendungsfälle

Lass uns nun über einige Beispiele für Anwendungsfälle sprechen, die in drei Hauptkategorien fallen, die wir als am wahrscheinlichsten für günstige Ergebnisse im nahen bis mittelfristigen Zeitraum identifiziert haben:

-

Natursimulationen. Aktuelle klassische Methoden der atomaren und molekularen Simulationen sind durch ineffiziente mathematische Beschreibungen der Atomstruktur begrenzt. Das Speichern und Manipulieren eines Quantenzustands erfordert exponentiell viele Ressourcen auf einem klassischen Computer, kann aber effizient auf einem Quantencomputer durchgeführt werden. Dies könnte zu Entwicklungen bei der CO₂-Sequestrierung, alternativen Batterien oder der Erfindung neuer Medikamente führen. Einige besonders relevante Algorithmen in diesem Bereich sind: der Variational Quantum Eigensolver (VQE), der zur Schätzung bestimmter Eigenschaften eines Materials wie Gleichgewichts- oder Minimalenergiezustände verwendet wird; der Time Dynamics Simulation (TDS)-Algorithmus, der zur Schätzung von Antwortfunktionen oder spektralen Eigenschaften von Materialien verwendet wird; und ein Newcomer, Sample-based Quantum Diagonalization (SQD), von dem wir glauben, dass wir in naher Zukunft noch viel mehr hören werden.

-

Optimierung. Dieser Bereich ist allgegenwärtig im Computing, daher sind die Anwendungsfälle zahlreich und vielfältig. Einige Beispiele, die wir häufig hören, sind Portfoliooptimierung im Finanzwesen, industrielles Design sowie Verteilung und Lieferkette. Der häufigste Algorithmus, den du im Zusammenhang mit dem Finanzwesen wahrscheinlich hören wirst, ist der, den wir bereits ausführlich behandelt haben: der Quantum Approximate Optimization Algorithm oder QAOA.

-

Quantum Machine Learning. Dieser Bereich hat in den letzten Jahren viel Begeisterung erzeugt, aber es ist wahrscheinlich, dass QML nicht so bald nützlich sein wird wie die Simulation. Dennoch gibt es einige beeindruckende Algorithmen, an denen gearbeitet wird, um einige sehr wichtige Anwendungsfälle anzugehen. Einige dieser möglichen Anwendungsfälle sind natürliche Sprachverarbeitung, Netzwerkverkehrsanalyse und sogar Betrugserkennung bei Finanztransaktionen. Relevante Algorithmen in diesem Bereich sind die Quantum Support Vector Machine (QSVM), Quantum Neural Networks (QNN) und Quantum Generative Adversarial Networks.

Innerhalb dieser breiten Anwendungsbereiche sieht die Community den Nutzen darin, dass Gruppen zusammenarbeiten, die sich auf ein spezifischeres Thema konzentrieren. IBM® hat eine Initiative namens Working Groups ins Leben gerufen, um Mitarbeitern zu helfen, sich gegenseitig zu finden und produktive Synergien in vier spezifischen Bereichen zu schaffen: Gesundheitswesen und Biowissenschaften, Materialien und High-Performance Computing (HPC), Hochenergiephysik und Optimierung. Kürzlich wurde auch eine fünfte Working Group zum Thema Nachhaltigkeit gegründet.

Wir werden uns jetzt einige Probleme genauer ansehen, die kürzlich von einigen dieser Working Groups bearbeitet wurden. Das Hauptziel dabei ist nicht, jedes Detail eines Experiments zu verstehen – das kann selbst für Experten schwierig sein, wenn das Papier leicht außerhalb ihres Fachgebiets liegt. Das Ziel ist lediglich, ein Gespür für die Arten von Problemen zu entwickeln, für die Quantencomputer geeignet sind, und wie wir sie angehen. Und wenn du interessiert bist, ermutigen wir dich, die vollständigen Papiere zu lesen.

Anwendungsfall 1: Simulation von Hadronen-Dynamik

Zunächst werden wir uns in ein Paper von Martin Savages Gruppe an der University of Washington vertiefen, das Quantum Simulations of Hadron Dynamics in the Schwinger Model Using 112 Qubits heißt.

Auch wenn du kein Hochenergiephysiker bist, bist du vielleicht mit dem Begriff „Hadron" vertraut, wie im Large Hadron Collider (LHC), dem riesigen Teilchenbeschleuniger mit einem Umfang von 27 km, der es schließlich ermöglichte, das Higgs-Boson zu beobachten. Ein Hadron ist ein subatomares zusammengesetztes Teilchen, das aus anderen kleinen Teilchen namens Quarks besteht. Einige Beispiele für Hadronen sind Neutronen und Protonen.

Zum Kontext: Der LHC wurde gebaut, um das Studium der Grundlagenphysik durch das Aufeinanderprallen von Teilchen bei extrem hohen Energien zu ermöglichen. Mit dem LHC hoffen Wissenschaftler, mehr über das frühe Universum und die Grundgesetze der Natur zu erfahren. Prinzipiell könnten die Wechselwirkungen dieser Teilchen mit einem ausreichend leistungsfähigen Quantencomputer von Anfang bis Ende simuliert werden. Wir sind noch nicht ganz so weit, aber wir machen Fortschritte.

Das Schwinger-Modell ist ein populäres, einfaches Modell, das zur Simulation einiger dieser Dynamiken verwendet wird. Es ist ein Modell, das das Verhalten von Elektronen und Positronen beschreibt, die in 1+1D über Photonen wechselwirken, also in Zeit und einer räumlichen Dimension. Das Modell hat viele Ähnlichkeiten mit der Quantenchromodynamik (QCD), die beschreibt, wie Quarks und Hadronen wechselwirken, aber QCD ist extrem schwer zu simulieren. Daher wird das Schwinger-Modell oft als Spielzeugmodell verwendet, um einige Phänomene zu untersuchen, die beiden gemeinsam sind.

Um zu verstehen, warum sie dieses Problem angegangen sind, stellen wir uns eine Reihe von Fragen.

Erstens, warum hatten sie Grund zu glauben, dass die Simulation davon auf einem Quantencomputer überhaupt funktionieren würde? In diesem Fall haben die Elektronen und Positronen im Schwinger-Modell einen Abschirmeffekt, der dazu führt, dass Korrelationen zwischen weit entfernten Fermionen exponentiell mit der Entfernung abnehmen. Das bedeutet, dass es nicht so viele notwendige Fernwechselwirkungen von einem Qubit auf einer Seite des Chips zu einer anderen gibt, was bekanntermaßen sehr fehleranfällig ist. Das ist also ideal für die Hardware, die wir heute haben.

Als nächstes: Warum ist dieses Thema von Interesse? Hochenergiephysik ist im Allgemeinen von großem Interesse. Die Menschen waren bereit, Milliarden von Dollar auszugeben, um den LHC zu bauen, und viele Tausende von Wissenschaftlern und Technikern auf der ganzen Welt haben ihre Karriere diesem Bereich gewidmet. Obwohl das Schwinger-Modell simplistisch ist und nicht für drei räumliche Dimensionen ausgelegt ist, ist es dennoch eine nützliche Vereinfachung der vollständigen Theorie.

Schließlich: Wie wurde diese Arbeit durchgeführt, oder wie würden wir das Problem angehen, wenn wir diese Arbeit fortsetzen wollten? Bei Simulationsexperimenten ist VQE einer der häufigsten Ansätze, und der erste Schritt ist fast immer derselbe: den Grundzustand vorbereiten. In diesem Fall handelt es sich um einen Vakuumzustand. In diesem Experiment verwenden sie eine neue Version von VQE namens SC-ADAPT-VQE (was für Scalable Circuits - Adaptive Derivative-Assembled Pseudo-Trotter ansatz-VQE steht), um sowohl den Grundzustand als auch das Hadronen-Wellenpaket auf diesem Vakuum vorzubereiten. Der nächste Schritt besteht darin, die Hadronen sich zeitlich entwickeln zu lassen. Schließlich werden die zu messenden Observablen identifiziert und gemessen.

Wenn diese Schritte – abgesehen vom Hadronen-Wellenpaket-Teil – etwas vertraut klingen, liegt das daran, dass sie dem, was wir im QAOA-Beispiel in der vorherigen Lektion behandelt haben, sehr ähnlich sind. Wir beginnen in einem bekannten Zustand (hier dem Vakuumzustand) und lassen ihn dann mit einer Reihe von exponentierten Hamiltonianern in der Zeit entwickeln. Viele Variationsalgorithmen folgen diesem allgemeinen Ansatz. Ein großer Unterschied hier ist jedoch, dass wir das Hadronen-Wellenpaket zentriert in unserem Circuit erzeugen, bevor wir es sich entwickeln lassen.

Wie erzeugen wir also das Wellenpaket? Auf dem Vakuum kann ein Hadron angeregt werden, indem ein Fermion-Antifermion-Paar auf benachbarten Gitterplätzen erzeugt wird. Durch Vorbereitung einer Superposition solcher Hadronen an verschiedenen Positionen kann ein beliebiges Wellenpaket vorbereitet werden. Die Autoren haben ihr Wellenpaket in der Mitte des Circuits zentriert, um die Evolution zu beobachten, ohne eine Grenze zu treffen.

Aber denk daran: Das Spiel beim Arbeiten mit verrauschten QPUs besteht darin, die Circuit-Tiefe handhabbar zu halten. Dazu verwendet das SC-ADAPT-VQE-Protokoll Symmetrien und Hierarchien in Längenskalen, um tiefenarme Quantencircuits für die Zustandspräparation zu bestimmen. Dies erzeugt einen Ansatz mit einer kleineren Anzahl von Parametern und damit einer geringeren Tiefe.

Das Experiment wurde auf einem IBM Quantum Heron-Gerät durchgeführt und umfasste verschiedene Arten von Error Mitigation und Error Suppression: Dynamical Decoupling, Zero Noise Extrapolation, Pauli Twirling und eine kürzlich entwickelte Technik namens Operator Decoherence Renormalization.

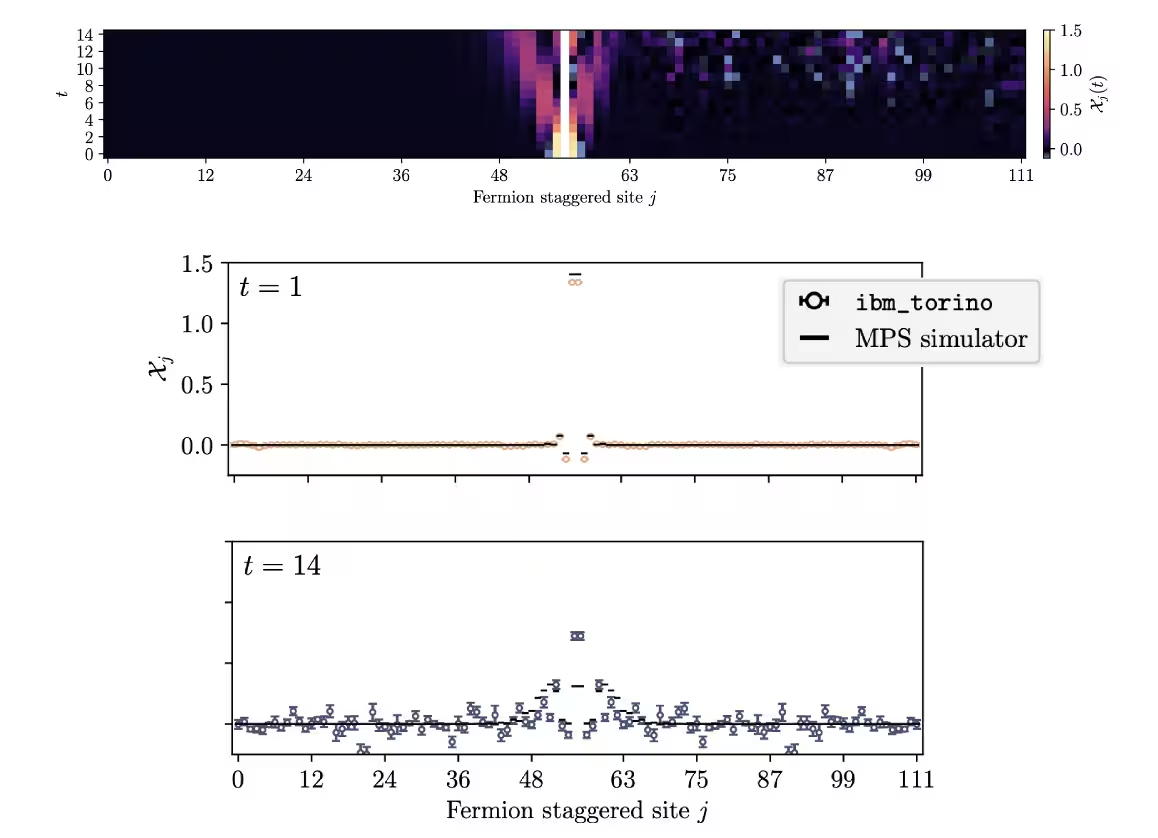

Oben ist eine Abbildung aus dem Paper, die die interessierende Observable zeigt, das chirale Kondensat, das im Wesentlichen eine suprafluide Phase der Hadronen ist. Wir können das Wellenpaket in der Mitte der Gitterplätze sehen, die für dieses Experiment vorgesehen wurden. Die schwarzen Linien sind die fehlerfreien Ergebnisse aus der (rechnerisch aufwändigen) klassischen Simulation, während die Punkte mit Fehlerbalken die Ergebnisse des 133-Qubit-IBM-Quantencomputers Torino sind.

Wir sehen zwei verschiedene Zeitschritte in der Wellenpaketvolution. Bei Zeit ist das chirale Kondensat schmal und lokalisiert, und es stimmt auch gut mit der klassischen Simulation überein. Bei ist es viel weiter ausgebreitet. Der Vergleich mit dem Simulator ist jetzt nicht mehr ganz so perfekt, aber man kann immer noch eine sehr gute Übereinstimmung zwischen Theorie und Daten erkennen, was ermutigend ist.

Zusammenfassend ist dies ein sehr cooles Beispiel für die Art von Simulationsarbeit, auf die man zunächst vielleicht nicht denkt, Quantencomputing anzuwenden, das aber echtes Versprechen zeigt. Es ist nicht perfekt, aber man muss kein Teilchenphysik-Experte sein, um zu sehen, dass der Quantencomputer die nach außen gerichtete Ausbreitung des Wellenpakets genau vorhersagt, was genau das ist, was wir erwarten würden. Hoffentlich wird die zukünftige Arbeit in diesem Bereich fortgesetzt, und Hochenergiephysiker werden weiterhin Wege finden, Quantencomputing in ihre Arbeitsabläufe einzubinden. Das Ziel ist es, schwierige theoretische Probleme präziser zu lösen und Experimente zu nutzen, um Theorien zu bestätigen oder zu verwerfen, in der Hoffnung, neue Physik zu entdecken, verbesserte Detektoren zu bauen und zu einem besseren Verständnis der Natur auf ihrer fundamentalsten Ebene zu gelangen.

Anwendungsfall 2: Optimierung eines Ising-Spin-Glases

Unser nächstes Beispiel konzentriert sich auf Optimierung und wird ein tiefer Einblick in ein Paper namens Bias-Field Digitized Counterdiabatic Quantum Optimization sein, das von Mitgliedern des Kipu-Quantum-Teams und der Universität des Baskenlandes in Spanien durchgeführt wurde.

In dem Paper entwickelten die Autoren eine neue Optimierungsmethode und wandten sie an, um den Grundzustand eines Ising-Spin-Glases zu finden. Wie bereits besprochen, können viele kombinatorische Optimierungsprobleme als Lösung von Niedrigenergie-Zuständen von Ising-Hamiltonianern umformuliert werden. Das Ising-Modell beschreibt die Wechselwirkung einer Anordnung mikroskopischer Spins. In einigen Regimen sagt das Modell voraus, dass sich die Spins wie ein Glas verhalten, bei dem die magnetischen Momente oberhalb einer sogenannten „Gefriertemperatur" ungeordnet sind.

Wir beginnen wie zuvor mit einer Reihe von Definitionen. Das erste ist gegendiabatisch (counterdiabatic), was eine Art Evolution ist, die nicht-adiabatische Effekte eines Systems unterdrückt, unabhängig davon, wie schnell diese Prozesse stattfinden. Erinnere dich an das adiabatische Theorem aus der letzten Episode – du musst ein System normalerweise sehr langsam entwickeln, wenn es im Grundzustand bleiben soll. Das ist ein großes Problem, denn je langsamer wir die Dinge entwickeln müssen, desto mehr Zeit haben wir für Fehler. Counterdiabatic Driving (CD) zielt darauf ab, dies zu bekämpfen, indem Terme hinzugefügt werden, die diesen unerwünschten Anregungen entgegenwirken. Die Grundidee besteht darin, das gesamte Experiment zu beschleunigen und die Circuit-Tiefe zu reduzieren, indem Anregungen unterdrückt werden, die unerwünschte Übergänge verursachen könnten.

Nun zum anderen Fachbegriff im Titel: das Bias-Feld. Andere iterative Algorithmen, wie VQE, führen klassische Parameter in die Zustände ein und verwenden klassische Optimierer, um den hochdimensionalen Parameterraum nach dem Satz von Parametern zu durchsuchen, der einen minimalen Erwartungswert für einen festen Hamiltonianer ergibt. In diesem Fall variieren sie stattdessen den Hamiltonianer jedes Mal und bewegen sich adiabatisch von einem bekannten Fall zum Fall von Interesse. Um den Hamiltonianer zu ändern, wenden sie einfach den Pauli-Z-Erwartungswert aus einer Iteration direkt als Bias-Feld im Hamiltonianer für die nächste Iteration an. Auf diese Weise lenken sie die Dynamik in Richtung der tatsächlichen Lösung, ohne klassische Optimierer zu benötigen.

Warum ist dieses Experiment also von Interesse? Ising-Spin-Gläser sind in der Physik von grundlegendem Interesse, aber dieser neue Ansatz ist sogar noch allgemeiner. Er könnte auf viele Optimierungsprobleme angewendet werden, daher ist das Paper von breitem Interesse.

Und warum dachten wir, das würde funktionieren? Der von ihnen vorgeschlagene Algorithmus beschleunigt die Evolution, um die Circuit-Tiefe zu reduzieren und dabei nicht-adiabatische Übergänge zu unterdrücken. Außerdem stützt er sich auf keine klassischen Optimierungsunterroutinen, die ein Problem führen können, das zu kahlen Plateaus und dem Feststecken in lokalen Minima führt. Schließlich stellen die Autoren auch sicher, die Wechselwirkungen im Problem-Hamiltonianer mit der Hardware-Konnektivität in den realen QPUs auszurichten, was immer sehr wichtig ist.

Wie funktioniert diese Methode also? Wieder verwendet sie keine klassischen Optimierer, anders als die meisten anderen iterativen Quantenalgorithmen. Stattdessen verfeinert der Bias-Field Digitized Quantum Optimization-Algorithmus den Grundzustand inkrementell und bringt ihn näher und näher an den endgültig entwickelten Zustand heran, indem er die Lösung aus jeder Iteration in die Eingabe für die nächste einspeist. Kombiniert mit den gegendiabatischen Protokollen können wir dies sogar mit kurztiefigen Quantencircuits tun, die reibungslos auf verrauschter Hardware laufen sollten.

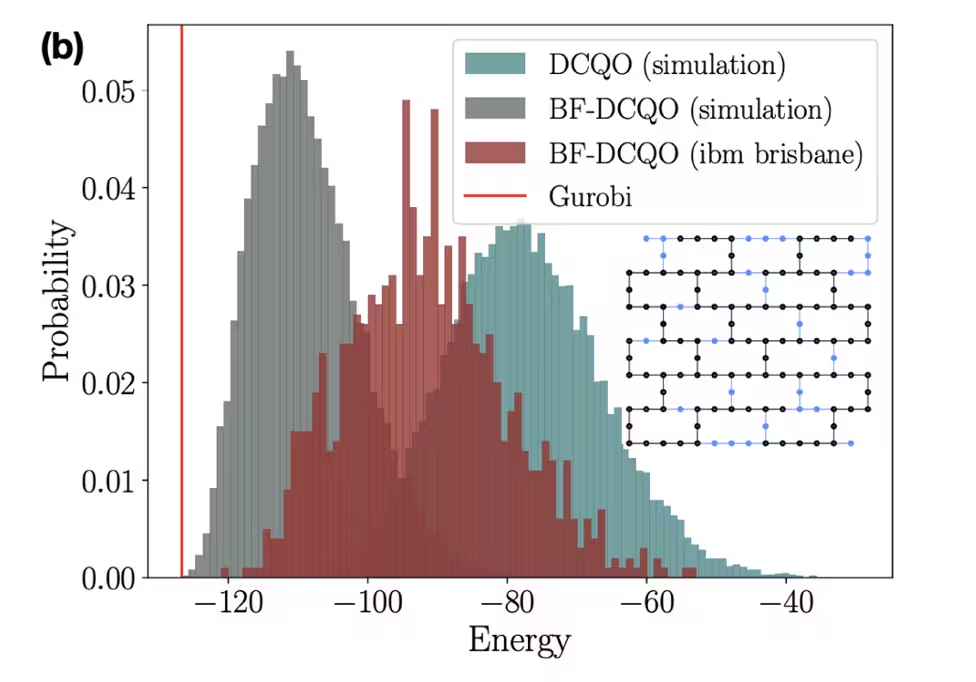

Als das Experiment durchgeführt wurde, entschieden die Autoren, den Algorithmus auf dem 127-Qubit-IBM-Quantencomputer Brisbane auszuführen. Unten ist eine Abbildung, die die 8. Iteration des Optimierungsalgorithmus für eine nächste-Nachbar-, zufällig generierte Spin-Glas-Instanz auf 100 Qubits zeigt. Sie vergleichen idealisierte klassische Simulationsergebnisse von DCQO und BF-DCQO sowie das experimentelle Ergebnis, das auf dem Quantencomputer ausgeführt wurde. Sie zeigen auch das Ergebnis eines klassischen Lösers namens Gurobi als Referenz. Mit nur 10 Iterationen liefert BF-DCQO eine drastische Verbesserung im Vergleich zu DCQO. Obwohl das experimentelle Ergebnis aufgrund von Rauschen etwas anders als das ideale Ergebnis ist, ist die Leistung immer noch besser als das ideale DCQO. Dies zeigt, dass noch immer erhebliche Fortschritte bei der Quantenoptimierung erzielt werden und erstmals gute Ergebnisse für über 100 Qubits gemeldet werden.

Anwendungsfall 3: Vorhersage der mRNA-Sekundärstruktur

Schließlich werden wir ein Paper von Moderna Pharmaceuticals diskutieren, das mRNA Secondary Structure Prediction Using Utility-Scale Quantum Computers heißt.

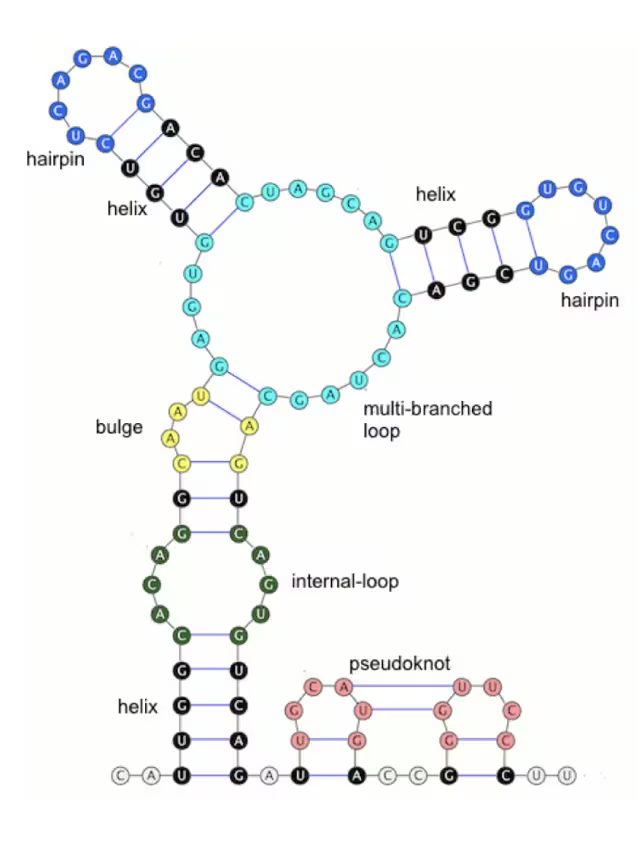

Zunächst eine kurze Auffrischung über mRNA. Messenger-RNA ist eine Art RNA, die an der Proteinsynthese beteiligt ist. Sie liest im Wesentlichen Anweisungen, die von der DNA gegeben werden. Die Sekundärstruktur der mRNA ist, wie die Kette gefaltet ist, wie im Diagramm unten gezeigt. Und das mRNA-Sekundärstruktur-Vorhersageproblem ist das Problem, die stabilste Faltung der Sequenz von Basen oder Nukleotiden zu finden, aus denen RNA besteht: Adenin (A), Cytosin (C), Uracil (U) und Guanin (G). Das Bild unten zeigt einige häufige Faltungsstrukturen, die in mRNA gefunden werden; jede Farbe stellt einen anderen Typ von Sekundärstruktur dar. Was eine Struktur günstiger macht als die anderen, ist nicht gut verstanden; wir können nur berechnen, welche Struktur die niedrigste freie Energie im Vergleich zum ungefalteten Zustand ergibt. Und genau hier kommen Quantencomputer ins Spiel.

Warum sind mRNA-Sekundärstrukturen also wichtig? Eine genaue Vorhersage davon ist nicht nur für das Verständnis der DNA und unserer Gene entscheidend, sondern auch für das Design RNA-basierter Therapeutika, wie dem COVID-19-Impfstoff.

Es ist seit langem bekannt, dass dies ein gewaltiges Optimierungsproblem für klassische Computer ist, aufgrund der riesigen Anzahl möglicher Konfigurationen. Für einige Konfigurationen ist bekannt, dass es sich um ein NP-vollständiges Problem handelt. Auf einem Quantencomputer können wir jedoch die Sekundärstrukturvorhersage als binäres Optimierungsproblem formulieren – etwas, mit dem wir umzugehen wissen. Darüber hinaus gab es bereits in der Literatur Beweise für genaue RNA-Vorhersagen auf kleinen Quantengeräten und Quantensimulatoren. Aber würde das auch auf größerer Hardware funktionieren?

Dieses Experiment wurde mit dem sogenannten Conditional Value at Risk Variational Quantum Eigensolver durchgeführt, was eine Modifikation eines traditionellen VQE-Algorithmus ist und eine bessere Konvergenz erzielen soll.

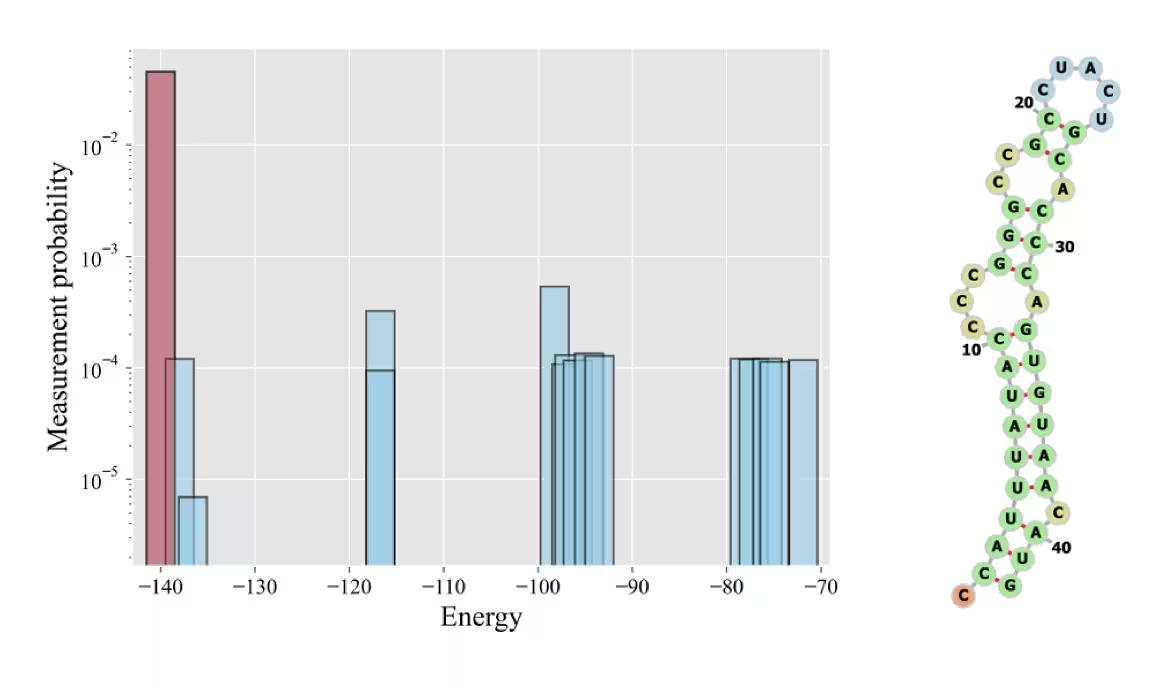

Der obige Plot zeigt die Verteilung der Messprobabilitäten der abgetasteten Bitstrings mit den entsprechenden Energien für eine 42-Nukleotid-, 80-Qubit-Instanz. Hier symbolisieren die Bitstrings Paarungen von Nukleotiden. Es zeigt, dass der niedrigste Energie-Bitstring, den der Quantencomputer gefunden hat, mit dem des vergleichenden klassischen Lösers übereinstimmt – das ist großartig. Ebenfalls gezeigt wird die optimale Faltungsstruktur dieser Nukleotidkette basierend auf dem niedrigsten Energie-Bitstring, den der Quantencomputer gefunden hat.

Fazit

Hoffentlich haben diese drei Anwendungsfälle dir genug Kontext gegeben, um zu verstehen, wie modernste Arbeit auf diesem Gebiet derzeit aussieht, und das Vertrauen, neue Quantenexperimente zu versuchen, die du vorher vielleicht nicht ausprobiert hättest.

Denke daran: Quantencomputing ist nicht für jedes Problem geeignet. Und das ist eigentlich nur ein Zeugnis dafür, wie gut wir im klassischen Computing geworden sind. Nur weil du glaubst, Quantencomputing auf ein Problem anwenden zu können, bedeutet das nicht, dass es interessante Ergebnisse liefern wird; du musst die Skalierung berücksichtigen.

Die Circuit-Tiefe ist ein zweischneidiges Schwert. Wir brauchen sie, um interessante Arbeit zu leisten, die klassische Computer nicht können, aber im Moment können wir die Tiefe nicht zu sehr erhöhen, weil das Hardware-Rauschen die Fidelität verringern wird. Es geht darum, diese goldene Mitte zu finden und zu wissen, dass es ein sich bewegendes Ziel ist. Also nimm dir etwas Zeit bis zur nächsten Lektion, um über ein Problem nachzudenken, dem du in deiner Forschung begegnet bist, und wie du es mit dem angehen könntest, was wir bisher gelernt haben. Und hey, deine Lösung muss nicht aufgehen, und das ist in Ordnung. Dafür betreiben wir ja Forschung.