IBM Quantentechnologie

Die Flotte der IBM®-Quantencomputer – alle mit mindestens 127 Qubits – ist die größte der Welt. Diese Quantencomputer verwenden supraleitende Transmon-Qubits, die zwar nicht die einzige Art von Qubits sind, aber viele Vorteile bieten. Die Kombination unserer erstklassigen Quantencomputer mit Qiskit ermöglicht es unseren Nutzern, heute schon zu erforschen, wie Quantencomputing in der Praxis nützlich sein kann. Branchenpartner und Forscher nutzen IBM Quantum®-Technologie, um bedeutsame Berechnungen und realistische Anwendungen zu erkunden. Lass uns die Breite der Programme und Dienste erkunden, die IBM Quantum seinen Partnern anbietet.

Wenn du einer Institution angehörst, die Mitglied des IBM Quantum Network ist, wende dich an die Quantencomputing-Gruppe deiner Institution, um herauszufinden, welche Vorteile dir zur Verfügung stehen.

Lernziele

Am Ende dieses Moduls solltest du in der Lage sein:

- Zu erkennen, dass die Lösung bedeutsamer Probleme eine Kombination aus Quanten- und klassischen Ressourcen erfordert.

- Die verfügbare Hardware, Software und Dienste zur Lösung bedeutsamer Probleme zu identifizieren.

- Zu beschreiben, wie die Leistung von Quantencomputern gemessen wird, einschließlich Skalierung, Qualität und Geschwindigkeit.

IBM Quantum Platform

Die IBM Quantum Platform bietet eine Suite von Quantencomputing-Tools, die alle für die Arbeit benötigten Forschungs- und Entwicklungsressourcen an einem Ort bündelt. Nutzer können ein Konto anlegen und sich anmelden, um Zugang zu IBM-Quantencomputern zu erhalten, Computerdetails einzusehen, Workloads zu verfolgen und in der Dokumentation und im Learning-Bereich auf Lernmaterialien zuzugreifen.

- Die Startseite dient als primärer Ausgangspunkt für das Produktökosystem, wo Nutzer ihre API-Schlüssel abrufen, eine Übersicht über ihre Instanzen und Nutzungsinformationen einsehen, aktuelle Job-Details abrufen und auf hilfreiche Links zu anderen Bereichen der Plattform zugreifen können.

- Die Dokumentation fasst Qiskit-Dokumentation, Service-Dokumentation und API-Referenzinformationen an einem Ort zusammen, geordnet nach natürlichen Arbeitsabläufen der Nutzer.

- Learning ist die Heimat für Lernmaterialien, einschließlich Kursen und Lehrmodulen sowie dem interaktiven Circuit Composer (demnächst verfügbar). Dieser kombinierte grafische und Code-Editor ermöglicht es Nutzern, Circuits visuell zu prototypisieren, zu simulieren und zu debuggen und sie anschließend auf IBM-Quantencomputern auszuführen.

Qiskit Runtime

Qiskit Runtime ist eine portable, sichere, containerisierte Architektur, die Quantenprogramme auf einer klassischen Recheneinheit ausführt, die eng mit dem Quantenprozessor integriert ist. Qiskit Runtime ermöglicht es dem Quantencomputer, Teil jeder Rechenumgebung zu werden und Berechnungen zu beschleunigen – ähnlich wie eine Grafikprozessoreinheit (GPU) – und übernimmt die Job-Orchestrierung und den Datentransfer zur Quantenverarbeitungseinheit, um die Effizienz zu maximieren.

Qiskit und Qiskit Runtime vereinfachen die schnelle Orchestrierung von Programmen über Rechenressourcen in der Cloud. IBM entwickelt Middleware für Quantencomputing, um die Leistung von Quantenanwendungen zu maximieren, die auf parallelisierten, cloudbasierten Quanten- und klassischen Rechenressourcen laufen. Diese Middleware umfasst das Circuit Knitting Toolbox und unsere Quantum Serverless-Architektur.

Das Circuit Cutting Qiskit Addon ermöglicht es Entwicklern, große Circuits in kleinere Circuits zu zerschneiden, die für aktuelle Quantencomputer geeignet sind. Circuit Knitting nutzt klassische Berechnungen, um einen Teil der Rechenlast eines Quantum Circuits zu übernehmen und so über das hinaus zu gehen, was allein mit Quanten- oder klassischen Computern erreichbar ist. Zusätzliche Tools helfen dabei, Circuits mit klassischen Ressourcen zu rekonstruieren und Endergebnisse zusammenzufügen.

Quantum Serverless ist ein Multi-Cloud-Orchestrierungs-Toolkit, das elastische klassische Ressourcen mit dem IBM Qiskit Runtime-Dienst verbindet. Quantum Serverless ermöglicht es Entwicklern, sich auf den Code zu konzentrieren statt auf die Ressourcenbereitstellung.

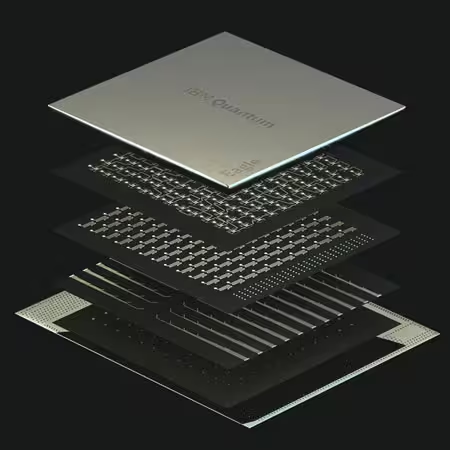

IBM supraleitende Quantencomputer

IBM-Quantenprozessoren verwenden einen physischen Qubit-Typ namens supraleitender Transmon-Qubit, der aus supraleitenden Materialien besteht, die auf einem Siliziumsubstrat strukturiert sind. Andere Quantenprozessoren könnten photonische Qubits verwenden, die aus einzelnen Lichtphotonen bestehen, oder gefangene Ionen-Qubits, die Informationen in geladenen Atompartikeln speichern. Um den Fluss elektrischer Ströme zu ermöglichen, müssen supraleitende Qubits bei extrem niedrigen Temperaturen gehalten werden – nahe dem absoluten Nullpunkt.

IBM 127-Qubit-Prozessor

Leistung von Quantencomputern

Messung der Leistung von Quantencomputern

Ein universell fehlertoleranter Quantencomputer ist die große Herausforderung des Quantencomputings. Es handelt sich um ein Gerät, das universelle Quantenoperationen mit unzuverlässigen Komponenten korrekt durchführen kann. Die heutigen Quantencomputer sind nicht fehlertolerant.

Um Quantencomputer miteinander zu vergleichen, reicht die Anzahl der Qubits nicht aus. Viele weitere Details müssen berücksichtigt werden, beispielsweise Fehlerraten und wie das System verdrahtet ist. Es gibt vier Schlüsselmetriken zur Messung der Quantencomputer-Leistung:

- Skalierung – Gemessen an der Anzahl der Qubits, was die Menge der Informationen angibt, die wir im Quantencomputer kodieren können.

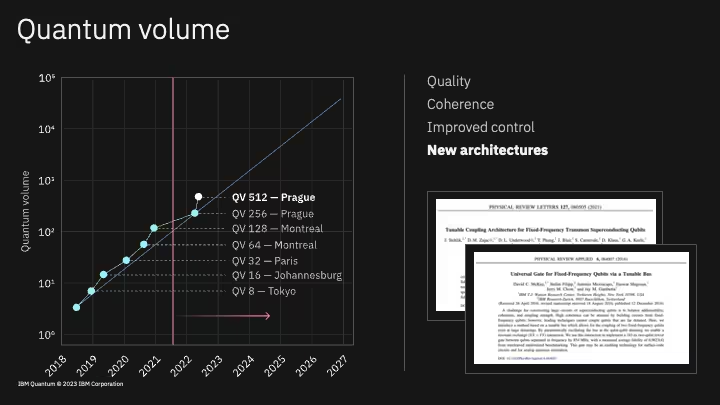

- Qualität – Gemessen am Quantum Volume, das die Qualität der Circuits und die Genauigkeit der Implementierung von Circuits in Hardware angibt.

- Geschwindigkeit – Gemessen an CLOPS (Circuit Layer Operations Per Second), das angibt, wie viele Circuits in einer bestimmten Zeit auf der Hardware ausgeführt werden können.

- Layer-Treue – Gemessen an EPLG (Errors Per Layered Gate), das beschreibt, wie Fehler auftreten, wenn Operationen auf Qubits ausgeführt werden.

Eine detailliertere Beschreibung einiger der oben genannten Metriken findest du in diesem Artikel im IBM Research Blog. Jede Phase der Einführung von Quantencomputing in der Industrie wird durch zunehmendes Quantum Volume vorangetrieben, das anhand verschiedener Parameter wie Circuit-Breite, Qubit-Konnektivität und Fehlerraten berechnet wird.

Die technische Definition des Quantum Volume lässt sich ohne Gleichungen schwer vermitteln. Dario Gil, Direktor für Forschung bei IBM, erklärt:

Um das Quantum Volume besser zu verstehen, betrachte folgende anschauliche Analogie. Der nachfolgende Abschnitt behandelt Zeit, Raum und Fehlerraten am Beispiel einer Stadtbesichtigung in New York.

Die Zustände des Quantum Volume auf Reisen

Das Quantum Volume beschreibt den größten Quantenberechnungsraum, den ein Quantencomputer erkunden kann, wobei das Volumen des Quantenraums 2N beträgt, mit N als Anzahl der Qubits, also der üblichen Zustandsraumdimension. Wir verwenden bewusst das Wort „Raum", denn sobald wir von Raum sprechen, liegt es nahe, auch an ein Volumen zu denken.

Der Faktor, der diese Erkundung begrenzt, ist die Fehlerrate. Die Fehlerrate kann mit der Zeit gleichgesetzt werden, die wir zur Erkundung des Raums haben. Mehr Fehler bedeuten weniger Zeit zum Erkunden. Je größer der Rechenraum ist, desto mehr Zeit braucht man, ihn vollständig zu erkunden – daher brauchen wir einen Quantencomputer mit einer geringeren Fehlerrate.

Stell dir eine Touristin vor, die New York City erkundet. Sie möchte die gesamte Stadt besichtigen, das heißt, sie strebt nach einem Touristenvolumen in der Größe von NYC. Wenn wir ihr nur einen Tag geben, gibt es keine Möglichkeit, so viel Raum zu erkunden – das gewünschte Touristenvolumen wird nicht erreicht. Wenn wir ihr jedoch drei Tage geben, kann sie wahrscheinlich alle Top-Sehenswürdigkeiten besuchen und das benötigte Touristenvolumen von NYC erreichen.

Was aber, wenn wir der Touristin mehr Zeit geben, aber den Raum weiterhin auf NYC beschränken? Anders ausgedrückt: Was wenn wir die Anzahl der Qubits gleich lassen, aber die Fehlerrate senken? Dann nützt es der Touristin nichts, denn sie hat die Stadt bereits erkundet und besucht nur noch dieselben Orte immer wieder. Das Touristenvolumen bleibt gleich. Bei mehr Zeit ist es stattdessen sinnvoller, die Anzahl der zu besuchenden Touristenattraktionen zu erhöhen.

Oder stell dir vor, wir lassen die Zeit auf drei Tage festgelegt, aber die Touristin versucht, ganz NYC und Long Island zu erkunden. Anders gesagt: Was wenn wir die Fehlerrate festhalten, aber mehr Qubits hinzufügen? Auch dann bleibt das Touristenvolumen auf NYC beschränkt, da die Touristin den größeren Raum in der verfügbaren Zeit nicht erkunden kann. Um eine bessere Touristin zu sein und ein größeres Touristenvolumen zu erreichen, muss man gleichzeitig den Erkundungsraum vergrößern und die zur Verfügung stehende Zeit erhöhen.

Genauso erfordert das Bauen besserer Quantencomputer mit größerem Quantum Volume gleichzeitig die Vergrößerung des Quantenberechnungsraums (Anzahl der Qubits) und die Senkung der Fehlerrate (Verlängerung der Zeit, in der der Algorithmus laufen kann). Beispielsweise hat IBM durch Fortschritte bei abstimmbaren Kopplungsarchitekturen das Quantum Volume in nur einem Jahr gleich zweimal verdoppelt!

Mit der Weiterentwicklung des Quantencomputings rückt jedoch die nützliche Arbeit, die unsere Quantencomputer in einer angemessenen Zeit verrichten können, stärker in den Fokus. Wenn wir Skalierung an der Anzahl der Qubits und Qualität am Quantum Volume messen, dann ist die Quantenverarbeitungsgeschwindigkeit das Maß für die nützliche Arbeit, die diese Qubits in angemessener Zeit leisten können. Wir definieren sie als die Anzahl primitiver Circuits, die pro Sekunde verarbeitet werden können. Sie ähnelt FLOPS im klassischen Computing – der Anzahl von Gleitkommaoperationen pro Sekunde. Die Verbesserung der QPU-Geschwindigkeit ist der Schlüssel zum praktischen Quantencomputing. Wie bei der klassischen Computerprogrammierung erfordert Quantenprogrammierung das Ausführen vieler Circuits. Eine vernünftige QPU-Geschwindigkeit ermöglicht es Nutzern, Quantencomputing in ihre Arbeitsabläufe zu integrieren.

Wissen überprüfen

Antwort

Richtig oder falsch: Das Quantum Volume bezieht sich auf die Größe der Kryokühlschränke, in denen IBM-Quantencomputer untergebracht sind.

Falsch. Das Quantum Volume ist eine einzelne Zahl, die die Leistung heutiger Quantencomputer zusammenfassen soll.

Was als Nächstes im Quantencomputing kommt

Die heutigen Quantencomputer – und die, die in absehbarer Zukunft erwartet werden – sind verrauscht. Das bedeutet, sie reagieren empfindlich auf Umweltstörungen, die die Genauigkeit der Ergebnisse beeinflussen können. Ähnlich wie sich das klassische Computing durch modulare Skalierung von Prozessoren, effiziente Berechnung und Parallelisierung weiterentwickelt hat, sehen wir das Quantencomputing auf dem Weg, sein volles Potenzial zu entfalten. Auf dem Weg zu vollständig fehlertoleranten Quantencomputern wollen wir nützliche Probleme mit der Hardware und Software lösen, die wir heute besitzen.

Quantum Utility

IBM Quantum und die University of California, Berkeley präsentierten Belege dafür, dass Quantencomputer dank Fortschritten bei IBM Quantum-Hardware und Fehlerminderungsmethoden früher als erwartet Mehrwert liefern können. Über einen bloßen Machbarkeitsnachweis hinaus haben wir Ergebnisse erzielt, die genau genug sind, um nützlich zu sein. Das Berechnungsmodell, das wir bei dieser Arbeit erkundet haben, ist ein zentraler Bestandteil vieler Algorithmen, die für kurzfristige Quantencomputer konzipiert sind.

Die Rückkopplungsschleife zwischen Quanten- und klassischen Computern ist entscheidend für den Fortschritt der Quantentechnologien. Mit einem Fokus auf Quantum Utility nutzen wir Quantencomputing, um komplexe Probleme zu untersuchen, die bestehende High-Performance-Computing-Frameworks herausfordern, und überprüfen die Ergebnisse klassisch. Dieses ständige Wechselspiel zwischen Quantencomputing, das komplexe Circuits ausführt, und klassischen Computern, die die Quantenergebnisse verifizieren, wird beide Rechenbereiche verbessern und Nutzern Vertrauen in die Fähigkeiten kurzfristiger Quantencomputer geben.

Optionale Lektüre – aufklappen, um mehr über das Experiment zu erfahren

-

In diesem Experiment haben wir alle 127 Qubits unseres IBM Quantum Eagle-Prozessors genutzt, um das sich verändernde Verhalten eines Systems zu simulieren, das sich natürlich auf einen Quantencomputer abbilden lässt: das Quanten-Ising-Modell. Ising-Modelle sind Vereinfachungen der Natur, die wechselwirkende Atome als Gitter wechselwirkender Quanten-Zwei-Zustands-Systeme in einem Energiefeld darstellen. Diese Systeme ähneln stark den zwei-Zustands-Qubits, aus denen unsere Quantencomputer bestehen, und eignen sich daher gut für den Test unserer Methoden. Wir verwendeten ZNE, um eine Eigenschaft des Systems namens Erwartungswert – im Wesentlichen ein gewichteter Durchschnitt der möglichen Ergebnisse des Circuits – möglichst genau zu berechnen.

-

Gleichzeitig versuchte das Berkeley-Team, dasselbe System mithilfe von Tensornetzwerk-Methoden mit Hilfe fortschrittlicher Supercomputer am National Energy Research Scientific Computing Center (NERSC) des Lawrence Berkeley National Lab und an der Purdue University zu simulieren.

-

Die Quantenmethoden stimmten weiterhin mit den exakten Methoden überein. Schließlich begannen die klassischen Näherungsmethoden jedoch zu versagen, als der Schwierigkeitsgrad erhöht wurde.

-

Schließlich baten wir beide Computer, Berechnungen durchzuführen, die über das exakt Berechenbare hinausgingen – und der Quantencomputer lieferte eine Antwort, der wir größeres Vertrauen entgegenbrachten. Obwohl wir nicht beweisen konnten, ob diese Antwort tatsächlich korrekt war, gaben uns Eagles Erfolge bei den vorherigen Durchläufen des Experiments das Vertrauen, dass sie es waren.

Fehlerkorrektur

Fehlerkorrektur ist seit Jahrzehnten ein wichtiger Forschungsbereich. Aber die meiste Zeit waren theoretische Fehlerkorrekturtechniken auf echten Quantencomputern nicht praktisch umsetzbar, meist wegen der sehr großen Anzahl benötigter Qubits. Tatsächlich sagen viele Experten voraus, dass praktisches fehlertolerantes Quantencomputing (FTQC) Millionen physikalischer Qubits erfordern wird. In einem kürzlich auf dem Cover von Nature veröffentlichten Artikel haben Forscher von IBM jedoch einen neuen Code eingeführt, den wir Gross-Code nennen, der diese Einschränkung überwindet.

Das Papier High-threshold and low-overhead fault-tolerant quantum memory beschreibt den neuen Quantenfehlerkorrektur-Code, der etwa zehnmal effizienter als bisherige Methoden beim Schutz empfindlicher Quantendaten vor Fehleransammlungen ist. Um zu verstehen, wie viel näher wir dem Beginn der Fehlerkorrektur nun sind: Mit dem Gross-Code kann man 12 logische Qubits für ungefähr eine Million Zyklen von Fehlerprüfungen mit 288 Qubits schützen.

Es wird nicht erwartet, dass Fehlerkorrektur plötzlich Fehlerminderung und Fehlerunterdrückung ersetzen wird. Vielmehr werden Fehlerminderung und -unterdrückung in den nächsten Jahren weiterhin eine entscheidende Rolle spielen, während gleichzeitig die Anzahl der fehlerkorrigierten Qubits zunimmt.

IBM Quantum Entwicklungs-Roadmap

Wir befinden uns nun fest in der Ära der Quantum Utility. Das bedeutet, dass Quantencomputer besser im Quantencomputing sind als klassische Computer und von unseren Nutzern genutzt werden können, um neue Algorithmen zu entdecken und nach Quantenvorteilen zu suchen. Unsere Roadmap skizziert unsere historischen Meilensteine und Pläne, bis 2026 einen kurzfristigen Quantenvorteil zu erreichen.

Bis 2029 werden wir Starling liefern – einen großformatigen fehlertoleranten Quantencomputer, der Quanten-Circuits mit 100 Millionen Quantengattern auf 200 logischen Qubits ausführen kann. Wir bauen dieses System gerade in unserem historischen Werk in Poughkeepsie, New York. Erfahre mehr über unseren Fortschritt in der Guided Roadmap PDF.

Lies mehr über die IBM Quantum Entwicklungs-Roadmap hier.

5k-Herausforderung

IBM arbeitet gemeinsam mit der Quantenforschungsgemeinschaft daran, potenzielle Anwendungsfälle zu finden, die von Quantencomputing profitieren könnten. Wir stellen zunehmend leistungsfähigere Tools zur Verfügung, damit Nutzer drängende Probleme mit Quantencomputing angehen können. Im Jahr 2024 veröffentlichten wir ein Tool, das unverzerrte Observablen langer, hochqualitativer Circuits berechnen kann. Die Suche nach dem, was sich mit dieser Kombination aus 100+ Qubits und tiefen Circuits tun lässt, wurde einst als „100x100-Herausforderung" bezeichnet. Aber die genaue Anzahl der Qubits und die Tiefe bei jedem sind weniger wichtig als die Nutzung der kombinierten Stärke. Stell dir vor, was mit 5.000 Quantum-Gates in einer einzigen Berechnung möglich ist. Nutzer können Quantum-Circuits mit Komplexität und Laufzeit ausführen, die die Fähigkeiten der besten klassischen Computer von heute übersteigen. Wir sind gespannt, was die Quantencommunity entwickeln wird, um die Möglichkeiten des Quantencomputings zu nutzen und wichtige Probleme zu lösen.

Quantenzentrierte Supercomputer

Der Schlüssel zur Lösung von Problemen in großem Maßstab liegt darin, über einzelne Chip-Prozessoren hinaus zu gehen. Im Jahr 2024 stellten wir Crossbill vor – den ersten Einzelprozessor aus mehreren Chips. Das sind die ersten Schritte in eine neue Ära der Skalierung und bieten einen klaren Weg zu 100.000 Qubits und darüber hinaus mit quantenzentriertem Supercomputing. Dies ist eine modulare Computerarchitektur, die Skalierung ermöglicht. Sie kombiniert Quantenkommunikation und -berechnung, um die Rechenkapazität zu erhöhen, während Hybrid-Cloud-Middleware eine nahtlose Integration von Quanten- und klassischen Arbeitsabläufen ermöglicht.

Die Lösung der komplexesten Probleme der Welt wird eine Kombination aus klassischen und Quantenressourcen erfordern. Darüber hinaus wird sie von der kontinuierlichen Zusammenarbeit zwischen Industrie und Wissenschaft abhängen.

Wichtige Erkenntnisse

Diese Erkenntnisse solltest du im Hinterkopf behalten:

- Die heutigen Quantencomputer sind nicht fehlertolerant.

- Das Quantum Volume ist ein ganzheitliches Maß dafür, wie gut ein Quantencomputer ist. Je höher das Quantum Volume, desto besser. Nur über die Qubit-Anzahl zu sprechen ist irreführend.

- Zur Messung der Leistung von Quantencomputern gibt es vier Schlüsselmetriken: Skalierung, Qualität, Geschwindigkeit und Layer-Treue.

- Ein gemeinsames Experiment von IBM Quantum und UC Berkeley lieferte Belege dafür, dass IBM-Quantencomputer bei anspruchsvollen Simulationsproblemen mit 127 Qubits zuverlässige und genaue Ergebnisse liefern.

- Quantenzentriertes Supercomputing bedeutet, Quantencomputing als Teil eines umfassenderen HPC-Paradigmas zu behandeln, bei dem klassische und Quantencomputer als eine einzige Recheneinheit zusammenarbeiten.